Google, “ajan çağı” için iki yeni ultra güçlü TPU tanıttı

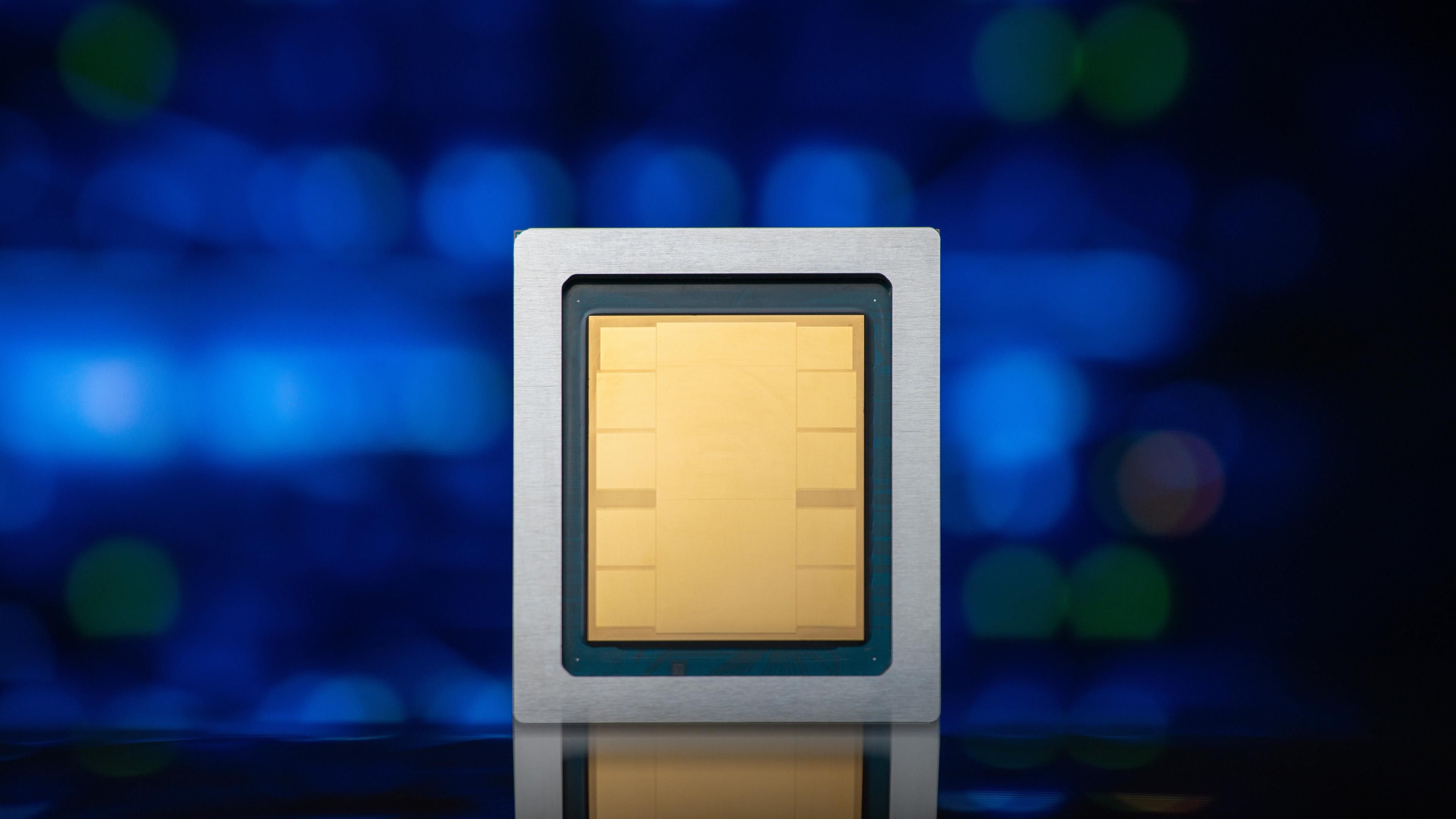

Google, yapay zeka altyapısında yeni bir dönemi hedefleyen sekizinci nesil Tensor Processing Unit (TPU) ailesini tanıttı. Şirketin önceki nesil Ironwood sonrası geliştirdiği yeni mimari, tek bir çip yerine iki ayrı özel işlemciden oluşuyor. Bu yaklaşım, Google’ın “ajan çağı” olarak tanımladığı yeni yapay zeka döneminin farklı donanım ihtiyaçlarına işaret ediyor.

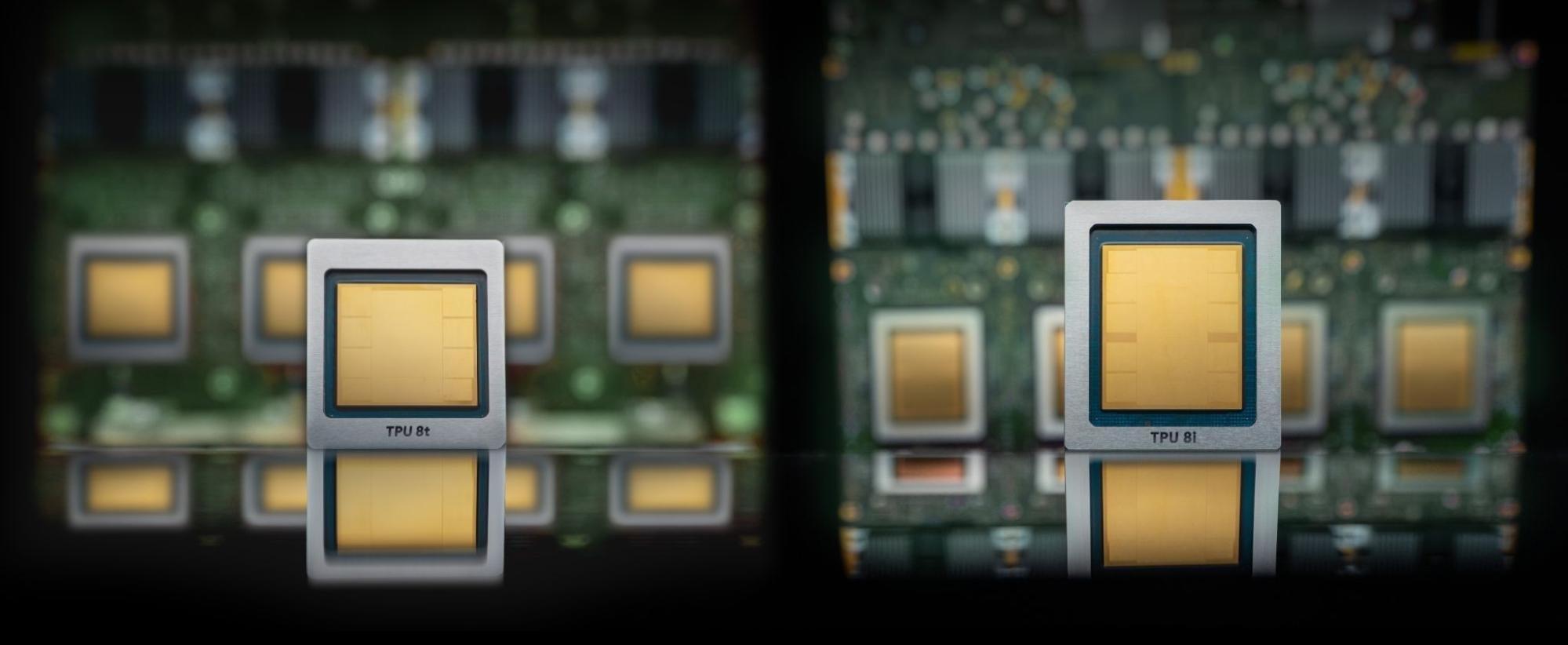

Google, yapay zeka altyapısında yeni bir dönemi hedefleyen sekizinci nesil Tensor Processing Unit (TPU) ailesini tanıttı. Şirketin önceki nesil Ironwood sonrası geliştirdiği yeni mimari, tek bir çip yerine iki ayrı özel işlemciden oluşuyor. Bu yaklaşım, Google’ın “ajan çağı” olarak tanımladığı yeni yapay zeka döneminin farklı donanım ihtiyaçlarına işaret ediyor. Yeni nesil TPU’lar TPU 8t (eğitim) ve TPU 8i (çıkarım/inference) olarak ayrılıyor. Google’a göre bu ayrım, model eğitimi ile modelin çalıştırılması arasındaki farklı hesaplama gereksinimlerini daha verimli şekilde karşılamak için tasarlandı.

Eğitimde dramatik hız artışı hedefi

Yapay zeka modellerinin geliştirilme sürecinin en yoğun kısmı olan eğitim aşaması, TPU 8t ile optimize ediliyor. Google, bu yeni işlemcinin büyük ölçekli modellerin eğitim süresini aylardan haftalara indirebilecek kapasiteye sahip olduğunu belirtiyor.

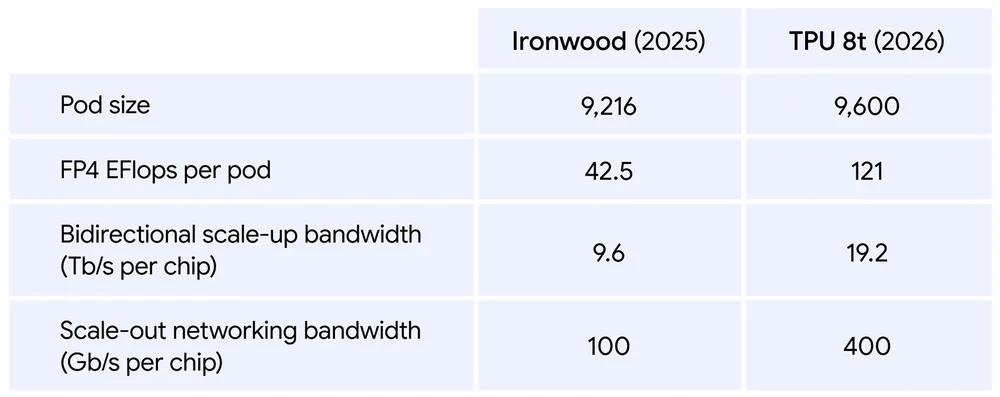

TPU 8t tabanlı yeni “pod” mimarisi, tek bir kümede 9.600 çipe kadar ölçeklenebiliyor. Bu sistemde toplam iki petabayt paylaşımlı yüksek bant genişliğine sahip bellek kullanılıyor. Google ayrıca mimarinin teorik olarak bir milyon çipe kadar ölçeklenebilen tek bir mantıksal küme oluşturabileceğini ifade ediyor.

Hesaplama gücü tarafında ise TPU 8t pod başına 121 FP4 exaFLOPS (EFlops) seviyesine ulaşıyor. Bu değer, önceki nesil Ironwood’un eğitim kapasitesinin yaklaşık üç katı olarak öne çıkıyor.

Hesaplama gücü tarafında ise TPU 8t pod başına 121 FP4 exaFLOPS (EFlops) seviyesine ulaşıyor. Bu değer, önceki nesil Ironwood’un eğitim kapasitesinin yaklaşık üç katı olarak öne çıkıyor. Google, TPU 8t’nin yalnızca hız değil, enerji başına verimlilik açısından da ciddi kazanımlar sunduğunu belirtiyor. Şirketin “goodpute” olarak tanımladığı metrik, çipin %97 oranında verimli hesaplama kullanımı sağladığını ifade ediyor.

Bu verimlilik artışının arkasında, düzensiz bellek erişiminin daha iyi yönetilmesi, donanım hatalarının otomatik şekilde ele alınması ve tüm çipler arasında gerçek zamanlı telemetri paylaşımı gibi geliştirmeler bulunuyor.

Çıkarım tarafında TPU 8i

Model eğitimi tamamlandıktan sonra devreye giren çıkarım süreci için Google, TPU 8i’yi konumlandırıyor. Bu işlemci, özellikle birden fazla özel yapay zeka ajanının aynı anda çalıştırıldığı senaryolara göre optimize edilmiş durumda.

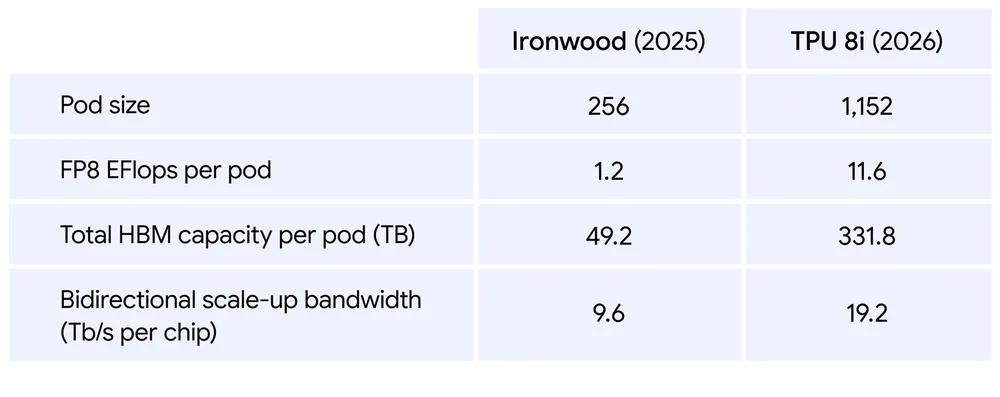

Model eğitimi tamamlandıktan sonra devreye giren çıkarım süreci için Google, TPU 8i’yi konumlandırıyor. Bu işlemci, özellikle birden fazla özel yapay zeka ajanının aynı anda çalıştırıldığı senaryolara göre optimize edilmiş durumda. TPU 8i pod yapısı önceki nesle kıyasla büyütülerek 1.152 çiplik kümeler haline getirilmiş. Bu yapı, Ironwood’un 256 çiplik çıkarım kümelerine göre önemli bir ölçek artışı anlamına geliyor. Ancak işlem gücü eğitim odaklı TPU 8t’ye kıyasla daha düşük seviyede ve pod başına 11,6 EFlops değerine ulaşıyor.

Bellek tarafında da dikkat çekici bir güncelleme bulunuyor. TPU 8i’de çip başına entegre SRAM kapasitesi 384 MB’a çıkarıldı. Bu artış, özellikle uzun bağlam penceresi gerektiren yapay zeka modellerinde daha büyük “key-value cache” tutulmasına imkân tanıyarak yanıt hızını artırıyor.

ARM tabanlı yeni mimari

Sekizinci nesil TPU ailesi, Google’ın donanım stratejisinde önemli bir değişimi de beraberinde getiriyor. Yeni sistemlerde artık yalnızca Google’ın geliştirdiği Axion ARM tabanlı CPU’lar kullanılıyor. Bu yapıda her iki TPU’ya bir CPU düşüyor. Önceki Ironwood mimarisinde ise bir x86 CPU dört TPU’ya hizmet veriyordu.

Sekizinci nesil TPU ailesi, Google’ın donanım stratejisinde önemli bir değişimi de beraberinde getiriyor. Yeni sistemlerde artık yalnızca Google’ın geliştirdiği Axion ARM tabanlı CPU’lar kullanılıyor. Bu yapıda her iki TPU’ya bir CPU düşüyor. Önceki Ironwood mimarisinde ise bir x86 CPU dört TPU’ya hizmet veriyordu. Google, yapay zeka sistemlerinin artan enerji ihtiyacına karşı yeni TPU ailesinde önemli verimlilik iyileştirmeleri yaptığını belirtiyor. Şirketin açıklamasına göre TPU 8 serisi, Ironwood’a kıyasla watt başına iki kat performans sunuyor.

Ayrıca veri merkezleri de TPU’larla birlikte yeniden tasarlandı. Compute ve ağ altyapısının aynı çip üzerinde entegre edilmesi ve daha verimli pod yerleşimleri sayesinde, birim enerji başına hesaplama gücünde altı kata kadar artış sağlandığı ifade ediliyor.

Google, TPU 8t ve TPU 8i’nin yalnızca kendi Gemini tabanlı sistemleri için değil, üçüncü taraf geliştiriciler için de hazırlandığını belirtiyor. Yeni işlemciler JAX, MaxText, PyTorch, SGLang ve vLLM gibi yaygın yapay zeka çerçeveleriyle uyumlu çalışıyor.

Her ne kadar Google kendi AI donanımını geliştirse de şirket, Nvidia’ya doğrudan ve tamamen bir alternatif olma hedefiyle hareket etmiyor. Aksine Google Cloud, Amazon ve Microsoft gibi diğer büyük bulut sağlayıcılarıyla birlikte Nvidia tabanlı sistemleri de altyapısında kullanmaya devam ediyor.